深度学习预测可解决自动驾驶等问题

到目前为止,自动驾驶汽车中使用的LiDAR的成本要高于某些低档汽车本身。激光雷达的维护和处理输出仍然是一项昂贵的工作,令人头疼。因此,这使得它们成为自动驾驶汽车的商业化生产的较不适合的选择。

激光雷达在计算“深度”信息方面非常准确,深度信息是无人驾驶汽车执行路径规划,与物体保持安全距离等操作的最重要内容之一。这使LiDARs成为集成到自动驾驶汽车中的理想选择。但是问题是,它们太贵了!

此前,高射程激光雷达的成本约为75,000美元。但是,为降低激光雷达的成本一直在进行昂贵的研究。Alphabet公司的母公司Waymo通过广泛的研究将成本降低了90%!

到目前为止,自动驾驶汽车中使用的LiDAR的成本要高于某些低档汽车本身。激光雷达的维护和处理输出仍然是一项昂贵的工作,令人头疼。因此,这使得它们成为自动驾驶汽车的商业化生产的较不适合的选择。

其次,LiDAR在恶劣的天气条件下不能很好地工作,它们会产生噪点,这可能会使LiDAR点云的输出不准确。

尽管如此,公司仍应该投资使用LiDAR和点云处理进行自动驾驶的方法,因为谁知道,也许有一天LiDAR也会变得便宜吗?

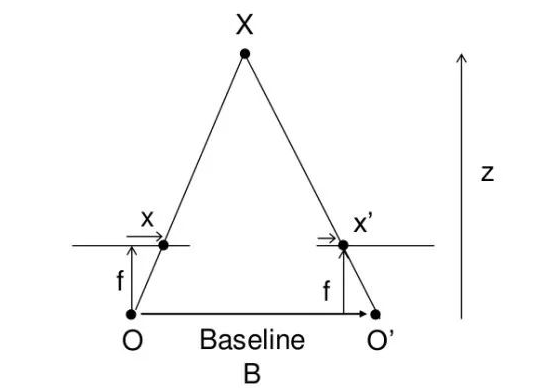

相机非常适合捕捉场景的高分辨率细节。但是问题是,它们没有像LiDAR那样为我们提供“深度信息” :(折衷方案在世界上到处都是。相机的输出是高分辨率,但是是2D平面图像。这几乎是不可能的。可以从单个图像中获取“深度信息”,有些方法可以使用立体视觉从图像中获取深度。

给定从放置在同一水平高度一定距离的两个摄像机捕获的两个图像,我们可以使用计算机视觉算法估计深度信息。

在计算机视觉文献中存在很多立体深度估计算法,但它们都无法同时实现:实时处理、高精确度、全自动的。

人类使用立体视觉(Eyes),即使深度仅为一幅图像,也能出色地估计深度。甚至可以闭上一只眼睛,并且仍然可以合理地估计深度!

人类是否真的在“学习”如何感知深度?我们无法真正回答这个问题。

但是,深度仍然可以被视为学习问题,因此深度“足够好”可以解决自我驾驶问题吗?

现在有几篇论文将视线深度估计作为学习问题:

1.监督深度估计

“监督”深度学习背后的概念很简单,收集RGB图像及其相应的深度图,训练类似于“自动编码器”的体系结构进行深度估计。(尽管训练起来不那么简单,但如果不通过训练过程整合一些特殊技巧,FCN就永远无法真正发挥作用:)。

尽管此方法更易于掌握,但在现实生活中收集深度图是一项昂贵的任务。LiDAR数据可用于训练这类网络,因此,如果我们对由LiDAR收集的数据进行训练,则神经网络的性能将明显优于LiDAR,但仍然可以,因为我们不需要那种级别的准确性来驾驶汽车例如,知道树上是否有叶子的确切距离。

2.无监督深度估计

仅在一系列环境中记录质量深度数据是一个具有挑战性的问题。无监督方法可以在没有地面真实深度图的情况下学习深度!

“这种方法只是查看未标记的视频,并找到一种方法来创建深度图,方法不是尝试正确,而是尝试保持一致。”

3.神经网络架构

该网络具有类似于U-Net的架构,编码器部分是在ImageNet数据集上训练的预训练DenseNet模型。解码器部分使用双线性上采样而不是简单的上采样。

简而言之,我们使用双线性上采样是因为它在上采样后会整体上产生“平滑”图像。输出是深度图,深度图是图像大小的一半,这有助于网络学习更快。

4.图像增强

对于图像增强,可以使用以下技术:图像翻转,输入图像的色彩通道改组,向输入图像添加噪点,增加输入图像的对比度,亮度,温度等。这样可以确保模型在整个训练过程中始终看到新数据,并更好地泛化未见数据。

目前,深度估计在AR / VR中已经得到了许多应用。